摘要:AI领域的蒸馏是一种模型压缩技术,旨在将复杂的深度学习模型转化为更小、更高效的模型。它通过训练小型模型以模仿大型模型的决策过程来实现知识的转移。这种技术不仅加速了模型推理速度,还降低了部署成本。在实际应用中,蒸馏技术广泛应用于模型优化、跨平台迁移以及知识传递等领域,促进了AI技术的普及和发展。

本文目录导读:

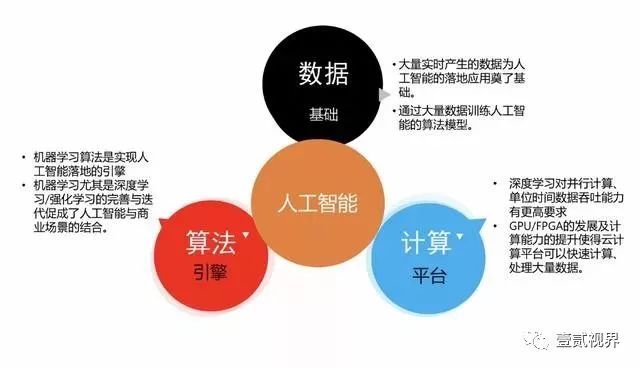

随着人工智能技术的飞速发展,新的概念和方法不断涌现,“蒸馏”便是AI领域中的一个重要概念,AI领域的“蒸馏”到底是什么意思呢?本文将为您深度解析这一概念的内涵及其在AI领域的应用。

什么是AI领域的“蒸馏”?

在AI领域中,“蒸馏”是一种模型压缩与知识传递的技术,它是指将已经训练好的大型神经网络(如深度学习模型)的知识转移到较小的模型或者更简单的模型中去,在这个过程中,大型模型(通常称为“教师模型”)的预测结果或者输出被用作训练小型模型(通常称为“学生模型”)的目标,通过这种方式,小型模型能够继承大型模型的性能,从而在保持性能的同时,实现模型的压缩和加速。

蒸馏技术的原理

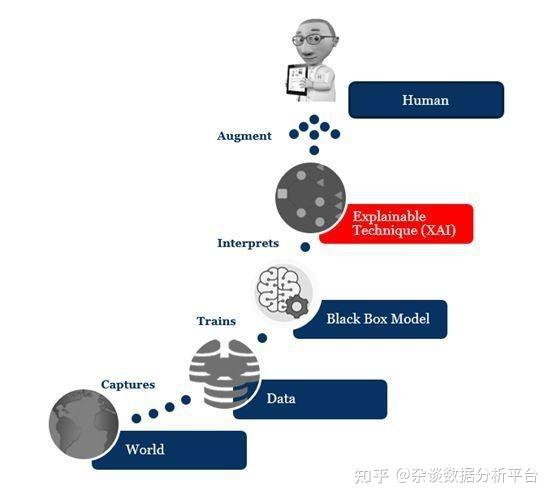

蒸馏技术的原理可以简单理解为一种迁移学习的方法,在迁移学习中,我们利用已有的知识或者模型去帮助解决新的问题,在蒸馏中,我们将大型模型的“软”输出(即概率分布而非简单的类别标签)作为小型模型的训练目标,这些软输出包含了大型模型的决策边界信息,这对于小型模型来说是非常有价值的,通过这种方式,小型模型能够学习到大型模型的决策逻辑,从而实现知识的传递和性能的继承。

蒸馏技术的应用

蒸馏技术在AI领域有着广泛的应用,它可以用于模型压缩和加速,在移动设备和嵌入式系统中,由于计算资源和能源的限制,需要较小的模型和更快的计算速度,通过蒸馏技术,我们可以将大型模型的知识转移到小型模型中,从而实现模型的压缩和加速,这不仅提高了模型的运行效率,还降低了能耗。

蒸馏技术还可以用于跨模态学习,在跨模态学习中,我们需要利用不同模态的数据(如文本、图像、语音等)来进行学习,通过蒸馏技术,我们可以将在一个模态下训练的模型的知识转移到另一个模态的模型中,从而提高模型的性能,蒸馏技术还可以用于多任务学习、半监督学习和无监督学习等领域。

蒸馏技术的优势与挑战

蒸馏技术的优势在于能够实现知识的迁移和共享,从而提高模型的性能和泛化能力,它还可以实现模型的压缩和加速,降低计算资源和能耗的需求,蒸馏技术也面临一些挑战,如何选择合适的教师模型和学生模型是一个关键问题,教师模型的选择直接影响到蒸馏的效果和性能,蒸馏技术还需要大量的计算资源和时间来进行模型的训练和调优,如何降低蒸馏技术的计算成本和时间是另一个需要解决的问题。

“蒸馏”是AI领域中的一种重要技术,它通过模型压缩和知识传递来提高模型的性能和泛化能力,本文详细解析了蒸馏技术的含义、原理、应用以及优势和挑战,尽管蒸馏技术面临一些挑战,但它的潜力巨大,有望在AI领域发挥更大的作用,随着技术的不断进步和研究的深入,我们有理由相信,蒸馏技术将在未来为AI领域带来更多的突破和创新。

京ICP备2020037689号

京ICP备2020037689号